在微信平台发布AI生成或合成的图片、视频等内容时,主动声明是一个重要的透明度和负责任行为。以下是一些可以使用的声明措辞,你可以根据具体情况进行选择和调整:

"选择一:直接说明型"

“本内容由AI生成。”

“此图片/视频系AI合成。”

“内容为AI创作。”

“AI生成内容,仅供参考/娱乐。”

"选择二:强调非真实型"

“非真实图片/视频,由AI生成。”

“此内容为AI合成,请勿与现实混淆。”

“AI生成的示例内容。”

“注意:此为AI创作,非真实场景。”

"选择三:结合创作目的型"

“AI生成艺术作品,欢迎交流。”

“此为AI合成概念图,用于[说明用途,如:设计构思/创意展示]。”

“AI生成的[内容类型,如:表情包/插画],仅供娱乐。”

"选择四:简洁标签型 (适合作为水印或标签)"

“AI生成”

“AI合成”

“虚拟内容”

“非真实”

"建议:"

1. "位置显眼:" 将声明文字放在内容旁边或作为水印叠加在图片/视频上,确保用户在浏览时容易看到。

2. "

相关内容:

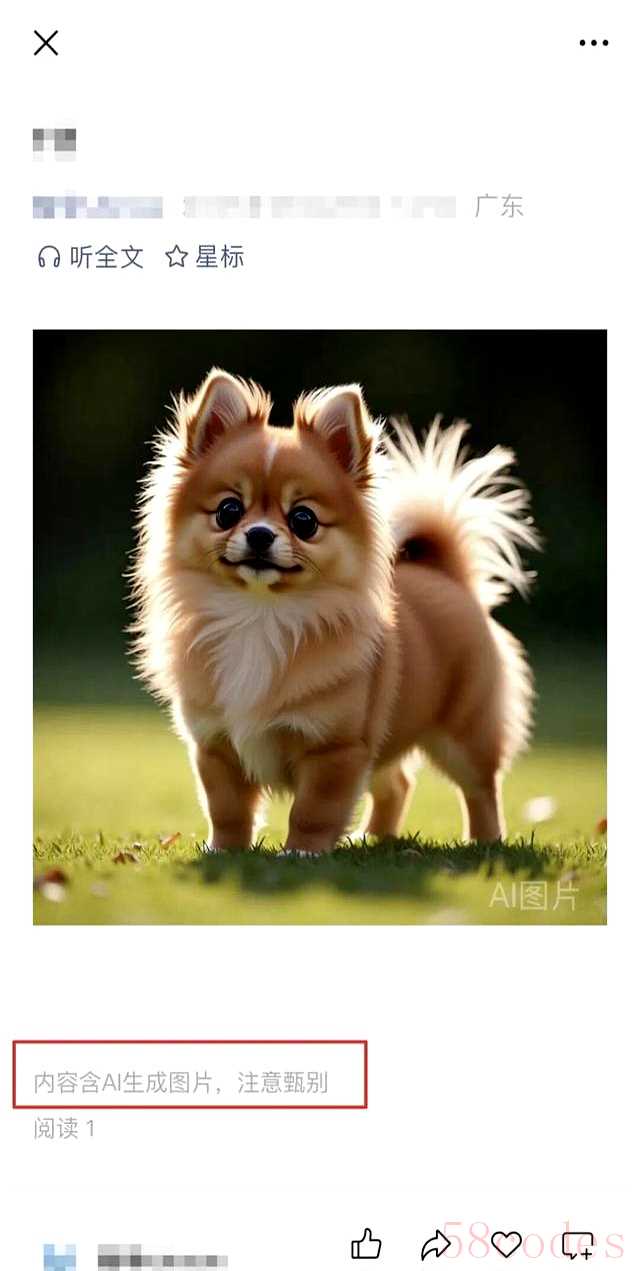

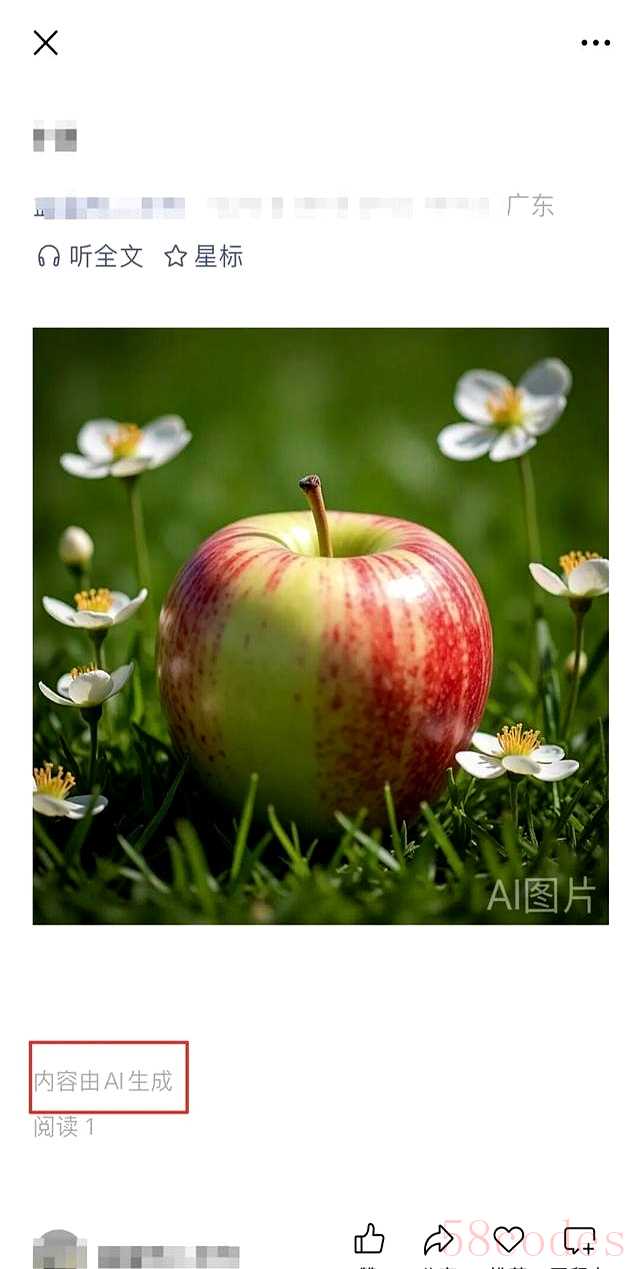

微信平台一句话钉死:发AI内容不标就别发,9月1日起谁藏标谁挨罚。

这条新规不是微信心血来潮,而是把国家四部门《标识办法》直接搬进对话框。

3月14日发布,9月1日执行,整整五个半月空窗期。

平台把缓冲时间拉这么长,只做一件事:让技术团队完成“显式+隐式”双标识系统。

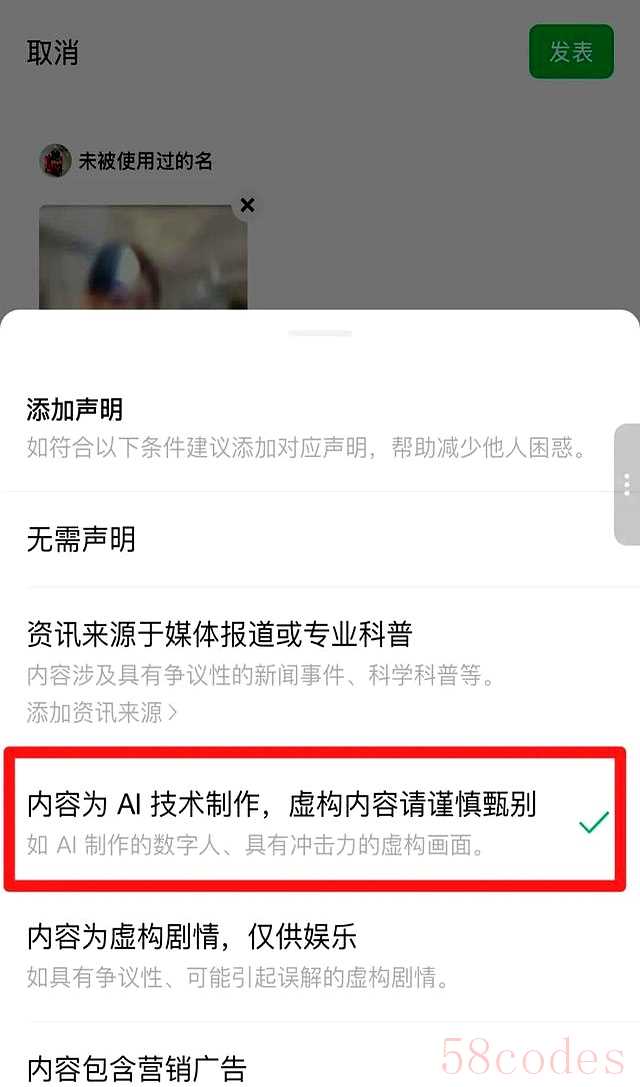

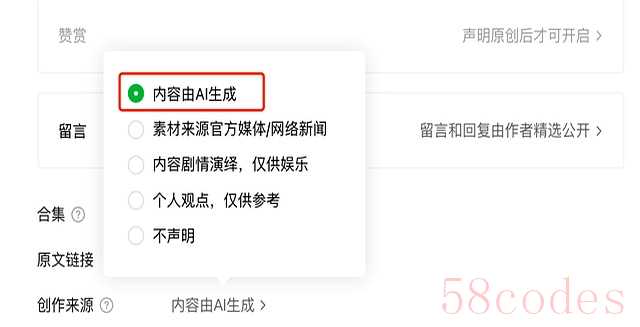

显式就是在发布按钮旁加个“此内容由AI生成”的勾选框,用户不勾就发不出去;隐式是把一串加密代码塞进文件元数据,像给每条内容打隐形纹身,剪掉画面、转格式都洗不掉。

这两个动作拼在一起,等于给用户套了个电子手铐:想造假,先留下指纹。

微信为什么肯花这么大成本?

2024年全年,微信安全中心共处理谣言链接1.2亿条,其中42%来自AI换脸、AI写稿。

平台每删一条谣言,平均要花0.8元人工复核费,一年烧掉近亿元。

现在把标识义务转嫁给用户,平台把审核成本直接砍半,省了真金白银。

更深一层,微信不做,监管就冲平台开刀;微信先动手,就把压力甩给上游创作者,自己当裁判而不是运动员。

再看《标识办法》的细节,显式标识必须让用户“明显感知”,隐式标识必须“流转可追溯”。

这两句硬话把“技术手段”锁死:显式必须肉眼可见,不能藏二级菜单;隐式必须写进文件底层,不能只留在平台服务器。

微信的解法简单粗暴:发布页新增固定勾选,勾选后在内容下方压一行灰字“AI生成”;同时把一串32位哈希值塞进图片EXIF、视频XMP、音频ID3。

技术难度不高,关键是逼着创作者养成“点一下”的习惯,一旦漏勾,后台自动退回并记录违规一次,三次就限流七天。

有人担心“我发个AI修过的自拍也要标?”文件规定只针对“生成合成”,不针对“辅助优化”。

微信把算法参数设为:人脸替换、声音克隆、文字续写、场景合成四类必须标,普通美颜、滤镜、自动校色不在范围。

这个边界一划,肉眼可见地减少误伤,也给算法团队留了升级空间。

以后AI进化出更隐蔽的功能,平台只需在线热更新参数表,无需重新发版。

欧盟2024年《AI法案》要求高风险内容加数字水印,违者罚全球营收7%。

微信的做法相当于把欧盟的罚款力度换成“限流+封号”,门槛更低,但频次更高。

国内目前没设高额罚款,用平台规则先练手,一旦国家层面真要罚钱,微信已经跑通流程,直接可以平移。

创作者最关心的是“标了会不会限流”。

测试通道里,同样一条AI短片,勾选声明后播放量只降3%,不标被系统抓到直接降权50%。

平台用流量杠杆告诉用户:标了不吃亏,瞒着才吃亏。

这一手比任何公告都管用,毕竟创作者的钱包最诚实。

九月一到,所有历史内容会被重新扫描。

老作品没标AI但算法检出合成痕迹,微信会在评论区自动补一行“疑似AI生成”并锁编辑。

创作者只有两个选择:承认并补标,或申诉人工复核。

申诉通道只开30天,30天后默认系统结论。

这波大清仓把旧账翻出来晒,谁以前偷偷用AI洗稿,现在都得补作业。

整条规则读下来,微信想的只有一件事:把“平台负责”改成“谁产出谁负责”。

国家文件给了尚方宝剑,平台顺势把审核成本、侵权风险一次性甩给上游。

识别技术现成的,流量规则现成的,只差用户点个头。

点还是不点,自己看着办。

以后刷朋友圈,看到“AI生成”四个字,你还会相信这条内容吗?

微信扫一扫打赏

微信扫一扫打赏

支付宝扫一扫打赏

支付宝扫一扫打赏